人工智能带给我们莫大的生活便利,但我们也在担心人工智能是否会进化至超越人类智能的那一天!更可怕的是,人工智能是否会像电影里的情节一样控制人类?

现今的科学研究也包含这方面的探索,研究员称之为“人工智能技术奇点”(AI Technical Singularity),也就是当人工智能超越人类智能的那一天。这听起来可能像是电影里才会出现的情节,但研究人工智能的科学家警告,人工智能奇点是一种真实的可能性,并可能在近几十年内发生。

《人工智能研究杂志》在2018年发表一项对人工智能专家的问卷调查显示,大部分研究人员认为,今天活着的人类至少有50%的机会,能够看到人工智能奇点的发生,而有些研究员甚至预计会在未来十年内发生。人工智能达到人类智能水平的那一刻,将标志着世界发生深刻的变化。这种复杂的人工智能,可以创造更多更先进的人工智能。而那个时候,我们对于人工智能的控制,可能会变得更加困难。

通用人工智能拥有普通人基本常识

人工智能早在1997年就曾引起了公众的注意,当时一个名为Deep Blue的智能程序,在他自己的游戏中,击败了当时的世界象棋大师Garry Kasparov。而最近,该技术已被用于自动驾驶、诊断癌症、协助手术以及其他应用。它甚至可以翻译语言,并在推特上引起你的注意制造广告效应,也可以帮助我们绘制更有效的驾驶导航,但这些都是狭义人工智能(Artificial Narrow Intelligence)的例子,它是为某个特定但复杂的任务而编程的。一个能打败围棋高手的程序,是不会自动导航的,可以发现肿瘤的人工智能也无法将日语翻译成法语。虽然的狭义人工智能在受过训练的事情上,比人类强大得多,但它并不能跟上人们能做的所有事情。与我们不同,狭义人工智能无法将它的智能应用于任何目标以外的事情上。

为此,伟大的研究员便开拓了通用人工智能的可能性,通用人工智能(Artificial General Intelligence-AGI)可将一套通用的知识和技能,应用于各种任务,简单来说,就是像一般人类一样拥有基本常识,而利用基本常识来完成我们日常的任务。这样的技术虽然目前不存在,但AGI将不再依赖一般人工设计的算法来做出决策或完成任务。

未来,计算机的进化速度将会比人类快得多,这让AGI可以一遍遍地自我构建更高智能的AGI,而这可能会更快的产生“超级智能”(Artificial Super Intelligence)。超级智能是个远远优于人类智能的人工智能,它可以适应特定情况并随时学习,而这就是专家们所谈论人工智能奇点的诞生。但是,在这一点上,我们可能还没有接近。

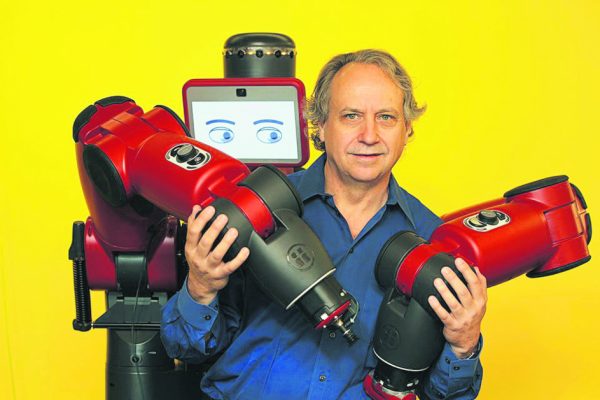

我们什么时候可以看见人工智能技能奇点的到来?机器人专家兼企业家Rodney Brooks曾说过:“人工智能领域,可能比大多数人想像的要落后几百年,我们甚至还没有弄清楚这些元素。”

人类命运或取决于超级智能行为

多伦多人类未来研究所的机器人工程师兼研究员Shane Saunderson说:“我们可能还没有弄清楚人类思维的精确程度,而我们现在却讨论人工智能奇点的想法有点言之过早。我们一开始对人类心理学和神经科学知之甚少,但科研结果曾预测工程师能在十年间建立类似人类的智能,我觉得这有点傲慢。”他补充说:“距离了解我们自己的智能还需要好几十年的时间,更不用说能在十年内复制它了。”

尽管如此,还是有人坚持认为AGI可能难以避免,即使我们还无法确定它何时会发生。麻省理工学院研究机器学习的物理学家Max Tegmark说道:“AGI一定会来,除非我们人类首先通过其他方式消灭自己,否则这将不可避免地发生,就像建造飞机比弄清楚鸟类如何飞行更容易一样,建造 AGI 可能比弄清楚大脑如何工作更加简单容易。”

尽管在这个问题上缺乏共识,包括已故的斯蒂芬霍金在内的许多科学家都警告过它的潜在危险。牛津大学哲学家Nick Bostrom在他的《超级智能:路径、危险、策略》一书中警告说,如果人工智能达到可不断自我改进的程度,我们人类的命运可能将取决于这台超级智能机器的行为。

面对超级智能的积极与消极态度

然而,这种命运不一定是悲惨的。专家们还指出,超级智能人工智能可以为我们的许多问题提供解决方案。如果我们无法弄清楚如何应对气候变化、消除贫困和确保世界和平,也许人工智能可以。泰格马克补充:“这项卓越的技术,有可能帮助每个人过上健康、富裕的生活,从而使人类能够以前所未有的方式蓬勃发展,”泰格马克也是未来生命研究所的创始人,该组织旨在确保这些积极成果会确实发生。然而,他也说:“如果它的目标与人类的目标不一致,它可能会消灭人类。”或者正如博斯特罗姆在《超级智能》中所说:“当面对智能爆炸时,我们人类就像个玩炸弹的小孩。”

应为AGI做好准备,而不是坐以待毙。无论它最终是灵丹妙药或是世界末日装置,我们都不想感到意外与遗憾。如果有合理的机会发展出人工智能奇点,泰格马克认为我们应该做好相应的准备。

“如果有人告诉我们外星入侵舰队将在30年后抵达地球,我们会事先为它做好准备,而不是在30年后才来吹嘘它。”泰格马克还指出:“我们可能需要至少3年的时间来弄清楚如何控制这项技术并确保其目标与我们的目标一致。我们不仅要做好控制它的准备,还要为人类的最大利益而使用它。”

当然,这是基于我们都可以就我们的利益达成一致性的目标而假设。然而,泰格马克乐观地认为,我们可以在基本问题上达成一致,并共同努力保护自己免受超级智能带来的生存威胁。如果气候灾难的威胁不足以将人类团结在一起,那么超级智能的前景和危险都将会和气候灾难一样。