AI伪造散播裸照 逾10万女性受害

(伦敦22日综合电)于2018年创办的智能公司Sensity发布报告说,有人在加密通讯软件Telegram上面散布大量裸体女性照片,但这些照片内的人物原本都是有穿衣服的,却被用人工智能(AI)技术移除了身上的衣服而变成裸照,已导致超过10万名女性受害。

ADVERTISEMENT

ADVERTISEMENT

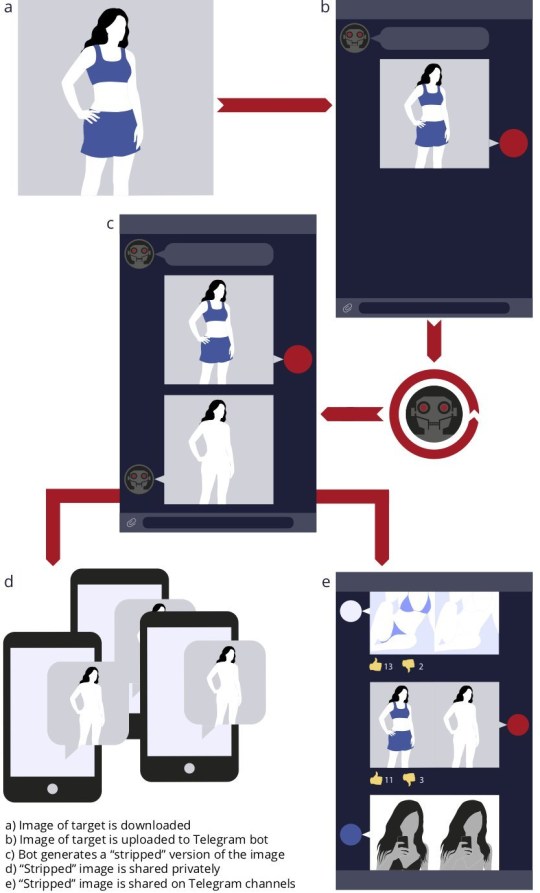

加密通讯软件Telegram中的一个私人群组提供了一个使用人工智能技术的“网络机器人”(自动软件),使用者送出一张女性照片,几分钟之内照片上的衣服就会被“数码移除”,不花一分钱。

提供这个造假裸照自动软件的管理员“P”表示,这个技术“纯属娱乐”非暴力,造出来的照片太不真实,所以没有人会因此被勒索。他还说,工作团队会检视哪些照片被人分享,“如果有未成年人我们会永久封锁该名用户。”

Sensity的首席执行官帕特里尼说,”只要你有社交媒体账号,上面有你的照片,就可以被人拿去造假裸照”;从2019年7月到2020年7月,大约有10万多名女性的照片被制作成造假裸照并公开分享,当中大部分为个人上传到社交媒体的照片被非法利用,而有些造假裸照上的人“看起来似乎未成年”,“显示有部分用户刻意利用这个自动软件生成并分享恋童癖内容”。

英国广播公司(BBC)在征求多位女性同意之后,用她们的照片进行实际测试,结果发现没有一张造假裸照看起来像是真的,其中一张还把照片上女性的肚脐放错了位置。

去年也曾经出现过类似软件后来被禁,但据信仍然有不同版本在网上流传。

除了恋童癖内容可能涉及违法之外,按照世界大多数国家目前的法律,造假的色情内容并不属违法。

美国的弗吉尼亚州去年成为全球第一个法律禁止“深度造假”的地方;英国法律在报复性色情内容和偷拍裙底等相关主题上有所进展,但关于造假裸照的相关法律则过时。

文:综合

图:互联网

ADVERTISEMENT

ADVERTISEMENT